原创 逛逛 2026-04-14 12:37 浙江

这个叫 Caveman 的开源项目,可能是最近全球开发者圈子里最有意思的 AI 省钱方案了。

前几天看到一个帖子,标题大概是教 Claude 用原始人语言说话来省 token。

我当时觉得这什么鬼,点进去一看,还真的有道理,

这个开源项目的核心思路特别简单直接:让 Claude 模仿原始人说话,砍掉所有客套话、解释性废话和修饰词,只留关键信息。

实测下来能省大约 65% 的输出 token,而且技术准确率不受影响。

01

开源项目简介

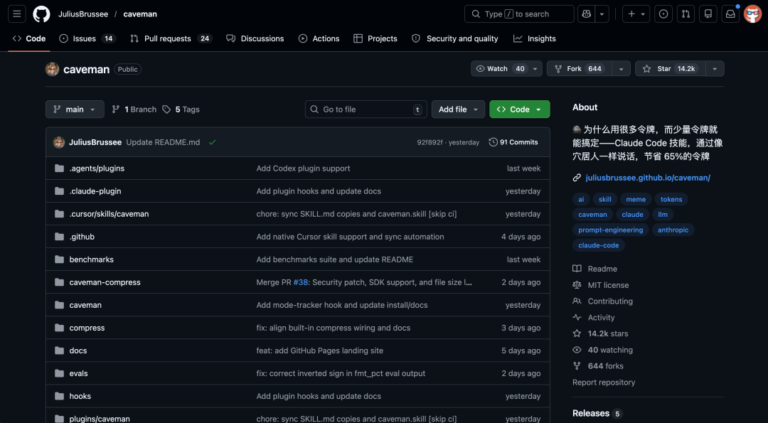

Caveman 是一个 Claude Code 的 Skill 插件,作者是一个 19 岁的开发者 Julius Brussee。

它做的事情一句话就能说清楚:强制 Claude 用极简风格回复你的问题,把那些”当然,我很乐意帮助你”之类的废话全部砍掉。

你可能觉得这不就是告诉 Claude 请简洁回答就行了?

还真不行。

Julius 在项目里做了对比测试,单纯告诉 Claude 要简洁,它的训练偏好会把它拉回啰嗦模式,效果很差。

但给它一个具体的人设,比如你是一个原始人,只会说短句,压缩效果就好得多。

这个发现挺有意思的,有点像方法派演员,你给一个具体的角色背景,比给一个抽象的指令效果好得多。

开源地址:github.com/JuliusBrussee/caveman02

核心功能

三档压缩强度

这个插件给了三档可选:

Lite 档:砍掉填充词和模棱两可的话,保留完整句子,适合日常使用

Full 档(默认):砍掉冠词,可以用碎片化表达,用更短的近义词替换,经典原始人风格

Ultra 档:极致压缩,电报体,用箭头表示因果关系,能省多少省多少

举个例子,同样是解释一个 bug,正常 Claude 可能会说:

根据我的分析,在您的代码第 42 行,我发现了一个潜在的问题。变量 user 可能为 null,建议您在使用前添加一个空值检查。

Ultra 模式下就变成了:

L42: user null. Add guard.

从 60 多个词压到 5 个词,信息量一点没丢。

文言文模式

这个是我觉得最妙的。

除了英文的原始人模式,它还提供了文言文模式,而且分了 wenyan-lite、wenyan-full、wenyan-ultra 三个子档。

文言文这个选择特别有道理。

人类历史上信息密度最高的文字系统之一就是文言文,同样一个意思,文言文用字最少,而且中文本身每个字的 token 就比英文少。

Caveman 把这个优势用到了极致。

比如一段代码审查意见,正常输出大概 850 token,文言文模式压到 420 token,省了一半。

配套子技能

除了主技能,它还带了几个实用工具:

caveman-commit:自动生成简短的 commit message,符合 Conventional Commits 规范,subject 不超过 50 个字符

caveman-review:一行式 PR review,直接指出问题,比如 L42: bug: user null. Add guard.,没有任何废话

caveman-compress:这个更狠,能把你的 CLAUDE.md、todo 文件、偏好设置之类的自然语言文件压缩成原始人语言,每次新会话加载的时候输入 token 也能省约 45%

安全阀设计

这个项目不是一味地省 token,它有一个 auto-clarity 机制。

遇到安全警告、不可逆操作的确认、多步骤序列(怕顺序搞混)、或者用户看起来有点懵的时候,会自动退出原始人模式,恢复正常回复。

另外还有一点值得提,README 里引用了一篇 2026 年 3 月的论文,叫 Brevity Constraints Reverse Performance Hierarchies in Language Models。

研究发现限制大模型输出简短回复,在某些基准测试上反而提升了 26% 的准确率。也就是说省 token 不是牺牲质量,在某种程度上还提升了质量。

03

如何使用

安装特别简单,在 Claude Code 里一行命令搞定:

claude plugin marketplace add JuliusBrussee/cavemanclaude plugin install caveman@caveman

如果你用的是 Cursor、Copilot、Windsurf 之类的其他 AI 编程工具,也可以通过 npx 安装:

npx skills add JuliusBrussee/caveman安装完之后,在对话里直接说 /caveman 或者 /caveman ultra 就能激活。

退出的话说 /caveman off 或者正常模式就行了。

它还支持 Hook 自动激活,每次启动 Claude Code 会话就自动进入 Caveman 模式,还能在终端状态栏显示当前档位,比如 [CAVEMAN:ULTRA]。

Caveman 这个项目看似搞笑,但背后触及了一个很真实的痛点:

LLM 的输出里大约 70% 是礼貌性的废话,而每一个 token 都是真金白银。

它给我们的启发是,在和 AI 交互的时候,与其被动接受它的啰嗦回复,不如主动约束它的表达方式。

而且这个约束越具体越好,一个有趣的人设比一句抽象的要求管用得多。

如果你平时用 Claude Code 比较多,尤其是跑自动化流水线或者高频交互的场景, Caveman 值得一试。

搭配 RTK 在输入端压缩,基本上能把 token 账单砍掉一大截。

04

点击下方卡片,关注逛逛 GitHub

这个公众号历史发布过很多有趣的开源项目,如果你懒得翻文章一个个找,你直接关注微信公众号:逛逛 GitHub ,后台对话聊天就行了:

补充阅读建议

如果你是通过搜索进入这篇内容,可以先确认它解决的问题、适用阶段和后续可复用的步骤,再决定是否继续深入。

评论(0)